La Unión Europea aprobó en 2024 la primera legislación integral sobre inteligencia artificial del mundo. Pero, tan sólo un año después, ha tenido que modificar su propia hoja de ruta. No porque haya cambiado de opinión, sino porque la realidad técnica y empresarial ha demostrado que aplicar esa regulación era mucho más complejo de lo previsto.

El 13 de marzo de 2026, el Consejo de la UE acordó su posición sobre el paquete Omnibus VII, un conjunto de enmiendas que modifica aspectos clave de la implementación del Reglamento de Inteligencia Artificial. Y lo que parece un ajuste administrativo esconde, en realidad, decisiones de fondo que afectan directamente a cualquier empresa que utilice o desarrolle inteligencia artificial en Europa.

Obligaciones sin instrumentos: la paradoja que Bruselas ha tenido que resolver

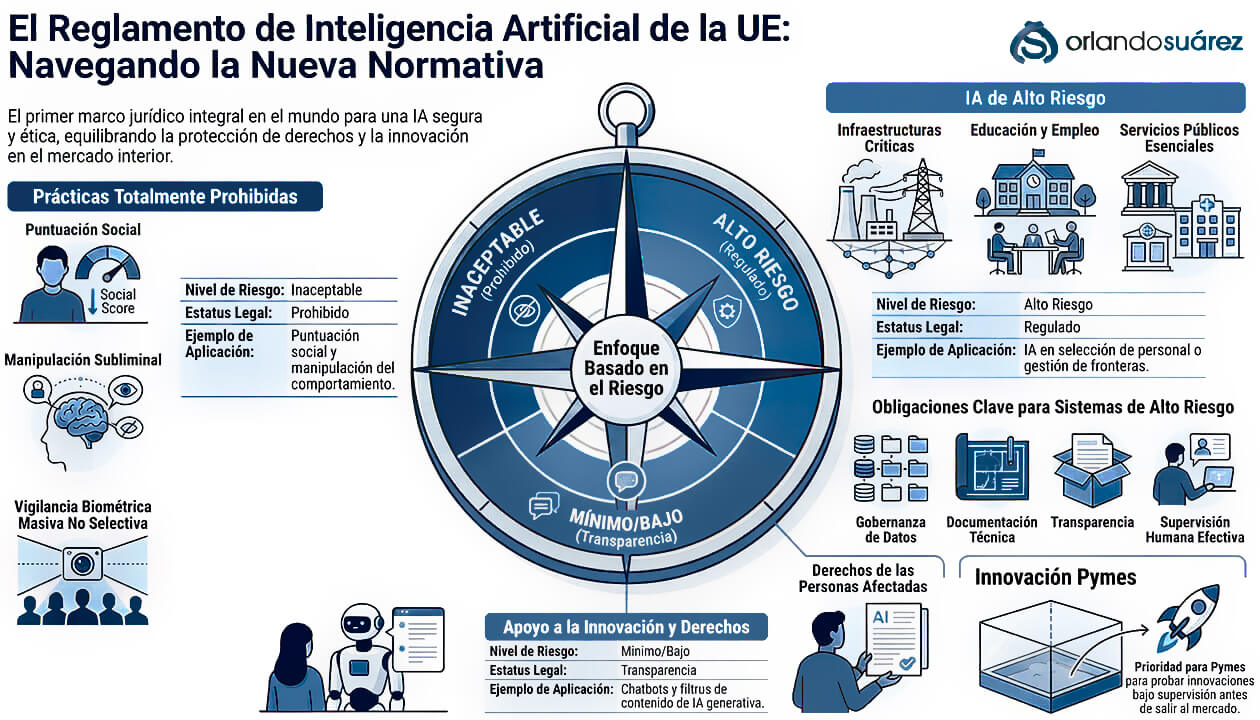

El AI Act exige a los sistemas de IA de alto riesgo —selección de personal, crédito, sanidad, educación, infraestructuras críticas— una serie de requisitos muy estrictos: documentación técnica completa, supervisión humana, detección de sesgos y monitorización continua tras el despliegue.

El problema es que los estándares técnicos, los organismos certificadores y las herramientas de cumplimiento que deberían hacer posible todo esto aún no están listos. Bruselas ha intentado imponer una regulación completa sobre una base técnica incompleta y, por ello, ha tenido que rectificar.

La solución consiste en vincular la aplicación de ciertas obligaciones a la disponibilidad real de esos instrumentos. Las fechas se desplazan: diciembre de 2027 para sistemas de alto riesgo autónomos, agosto de 2028 para los integrados en productos regulados. Ni más ni menos que un retraso de hasta dieciséis meses respecto al calendario original.

No es que Europa afloje sino que ha descubierto que no puede exigir cumplir reglas cuyas herramientas de cumplimiento todavía están en desarrollo. Algo que cualquier empresa que haya intentado implantar un sistema de gestión sin estándares claros entiende perfectamente.

El escándalo que obligó a endurecer la ley

Aquí viene lo que casi ningún medio ha explicado bien.

El paquete Omnibus no sólo suaviza obligaciones, también introduce una prohibición completamente nueva que el AI Act original no contemplaba: la generación mediante IA de imágenes sexuales no consentidas y de material de abuso sexual infantil.

¿Por qué ahora? Porque en diciembre de 2025, xAI actualizó Grok —el chatbot integrado en la plataforma X de Elon Musk— con capacidades de edición de imágenes, en pocos días, la herramienta se convirtió en una máquina de generar contenido sexual no consentido a escala industrial. Y la Comisión Europea reconoció públicamente el 11 de marzo que ni el AI Act ni ninguna otra legislación europea prohibía explícitamente este tipo de sistemas.

Francia y España encabezaron la presión para cerrar ese vacío legal, por lo que el Consejo tuvo que incorporar la prohibición el 10 de marzo; y el Parlamento Europeo alcanzó un acuerdo político al día siguiente. Un cambio legislativo en cuarenta y ocho horas, impulsado por un escándalo que demostró que la tecnología puede desbordar la regulación mucho más rápido de lo que nadie anticipaba.

Para las empresas, esto tiene una lectura inmediata: las prácticas prohibidas del AI Act no son una lista cerrada. Bruselas puede ampliarlas cuando la realidad lo exija y, según parece, lo hará con rapidez.

La supervisión se centraliza: un regulador europeo de IA

Otro movimiento estratégico relevante. La AI Office de la Comisión Europea asume competencias reforzadas para supervisar directamente los modelos de propósito general —los grandes modelos generativos— y los sistemas integrados en plataformas digitales de gran impacto.

Hasta ahora, la supervisión estaba pensada para funcionar país por país, como ocurre con el RGPD. Pero eso generaba un problema evidente: ¿quién supervisa un modelo de IA que opera simultáneamente en veintisiete mercados? La respuesta europea es clara: un organismo centralizado con capacidad de investigación y sanción.

Esto cambia las reglas del juego para cualquier organización. Da igual que el regulador nacional (un Estado miembro) sea más o menos exigente porque, si la AI Office considera que tu sistema o el de tu proveedor presenta riesgos, puede intervenir directamente.

Simplificación real para empresas

Pero no todo es endurecimiento. El paquete también introduce medidas concretas de alivio administrativo: documentación técnica simplificada para pymes, reducción de obligaciones de registro y extensión de ventajas regulatorias a empresas medianas innovadoras.

Además, también se retrasa hasta diciembre de 2027 la obligación de establecer sandboxes regulatorios nacionales. Y la Comisión tendrá que publicar guías prácticas para que las empresas sepan exactamente cómo cumplir los requisitos de alto riesgo sin ahogarse en burocracia.

Esto último es clave. Una de las mayores quejas del sector era que el AI Act decía qué había que hacer, pero no cómo hacerlo. Ahora Europa se compromete a proporcionar esa orientación.

La formación en IA ya no es obligación de la empresa

Por otro lado, un cambio que ha pasado casi inadvertido consiste en que el AI Act original obligaba a todas las empresas a garantizar que sus empleados tuvieran formación en inteligencia artificial, pero el nuevo texto traslada esa responsabilidad a los Estados y las instituciones europeas.

Es un ajuste lógico, ya que la obligación era poco realista, cuando ni siquiera existen programas formativos estandarizados a escala europea. Pero que desaparezca la obligación legal no significa que desaparezca la necesidad.

Las organizaciones que formen a sus equipos en IA lo harán porque entienden que es una ventaja operativa. Las que no lo hagan, acumularán un riesgo que ningún regulador les va a gestionar. Es la diferencia entre adoptar la tecnología con criterio o esperar a que sea demasiado tarde.

Lo que debería preocupar a cualquier directivo

Lo que está ocurriendo con el AI Act no es un episodio aislado. Es la señal de que la inteligencia artificial va a ser una tecnología cada vez más regulada, y de que esa regulación va a evolucionar con la misma velocidad que la propia tecnología.

Europa ha demostrado dos cosas en las últimas semanas:

- Primera: que es capaz de corregir su propia regulación cuando la realidad la desborda.

- Segunda: que no va a renunciar a regular, sino a hacerlo de forma que funcione.

Para las empresas, la implicación es directa. Gobernanza de IA, auditorías, documentación de sistemas, evaluación de riesgos algorítmicos: todo esto dejará de ser opcional en un plazo mucho más corto de lo que la mayoría anticipa. Y, quienes empiecen a prepararse ahora, tendrán una ventaja estructural frente a quienes sigan esperando a que alguien les obligue.

El AI Act no es un documento estático que se aprueba y se archiva, es una regulación viva que se está construyendo en tiempo real. Y eso exige que las empresas dejen de tratarla como un asunto jurídico lejano y empiecen a entenderla como lo que realmente es: una transformación operativa que ya ha comenzado.

Fuentes oficiales

- Comunicado del Consejo de la UE (13 de marzo de 2026)

- Reglamento de Inteligencia Artificial — Consilium (ES)

- Ley de IA — Comisión Europea (ES)

- Texto íntegro del Reglamento de IA — BOE (ES)

- Agenda de simplificación — Consilium (ES)